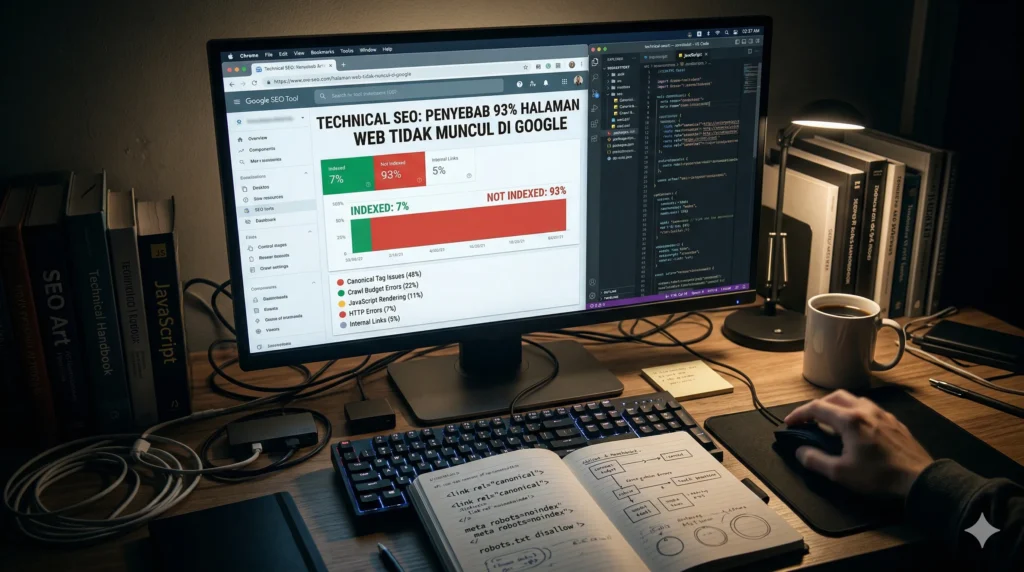

Suka kesel gak sih udah capek-capek bikin puluhan bahkan hingga ratusan artikel, tapi kok ketika di cari di google gak ada, eh bahkan bukan gak ada, ke index ajah kaga.

Itu berarti, artikel kamu gak di notice alias tidak ditemukan oleh Google untuk di Crawling.

Akhirnya si Atasan bilang gini deh ke kamu “Kamu udah bikin banyak artikel kok trafiknya segini-segini saja? harusnya naik dong, ini malah turun terus, gimana sih kamu, kerja gak becus” :v. pernah kan digituin sama Atasan?

Padahal artikel atau halaman yang kamu publish udah lebih dari 2 bulan, tapi masih ajah gak muncul di Halaman pertama Google.

Kamu mau tahu gak kenapa bisa seperti itu dan solusinya harus ngelakuin apa? kalau mau tahu, silakan di simak yah sharing saya kali ini.

Google Itu Sibuk, Sangat Sibuk

Inget, ada jutuaan website yang sedang mengudara, ada miliaran halaman baru dan halaman yang diperbarui setiap harinya. Sehingga Google Bot harus ngunjungi semua halaman tersebut.

Nah masalahnya, Google Bot itu punya keterbatasan. Setiap dia berkunjung ke 1 website, dia hanya di kasih waktu kunjungan terbatas, istilan teknisnya “crawl budget“.

Analoginya begini, Google itu ibaratkan seperti quality inspector yang harus ngecek ribuan Apookat Mart di seluruh Indonesia. Setiap hari dia punya jadwal kunjungan yang terbatas untuk setiap Cabang Apookat Mart yang kamu miliki , misalnya dia cuma bisa datang 2 jam.

Nah pertanyaannya, selama 2 jam itu, dia ngapain aja di toko kamu?

Kalau 2 jam itu habis untuk ngecek rak-rak lama yang sudah pernah dia periksa sebelumnya, kapan dia sempat melihat produk baru yang baru saja dipajang?

Itulah yang terjadi pada crawl budget.

Lebih dari 95% Waktunya Habis untuk Hal yang Sama

Ini yang sering bikin saya kaget setiap kali audit website berskala besar.

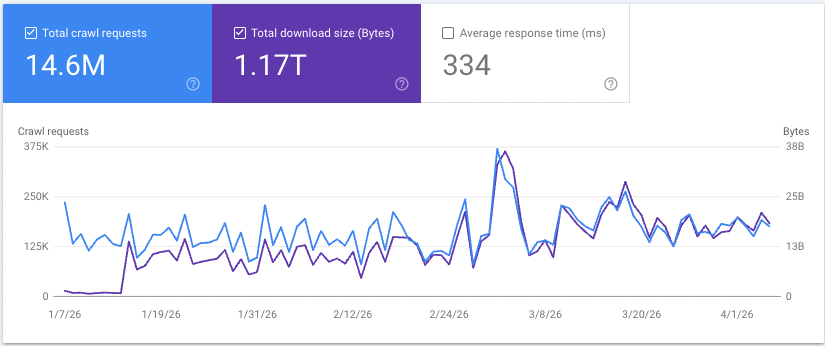

Di beberapa website yang kami tangani, lebih dari 95% crawl budget Google dihabiskan untuk “refresh,” yaitu mengunjungi ulang halaman yang sudah pernah dicrawl sebelumnya. Sisanya, yang kurang dari 5%, baru digunakan untuk “discovery,” yaitu menemukan halaman baru.

Bayangin, dari ratusan ribu kunjungan Google Bot per hari ke sebuah website, cuma beberapa ribu yang dipakai untuk memproses halaman baru. Padahal halaman yang belum pernah di-index bisa ratusan ribu.

So, dengan kecepatan seperti itu, butuh berapa lama sampai semua halaman baru terproses?

Jawabannya “Akan sangat lama sekali :v”

Kenapa Crawl Budget Bisa “Bocor”?

Crawl budget itu seperti ember, kalau embernya bocor di banyak tempat, air yang sampai ke tanaman (halaman penting kamu) jadi sedikit.

Dari pengalaman saya menangani berbagai kasus, ada beberapa penyebab umum kebocoran crawl budget.

Pertama, terlalu banyak halaman error

Ini penyebab yang paling umum. Di beberapa website yang kami audit, 3–5% dari seluruh crawl requests menghasilkan error 4xx. Kedengarannya kecil ya? Tapi kalau total crawl requests kamu jutaan dalam 3 bulan, itu berarti ratusan ribu request akan terbuang sia-sia.

Setiap kali Google Bot mengunjungi 1 halaman yang error, maka semakin banyak waktu yang terbuang. Nah masalahnya yang bikin saya frustrasi, Google Bot sering banget balik lagi ke URL error yang sama berulang kali, akhirnya menghabiskan budget lebih banyak lagi.

Kedua, resource loading yang berlebihan

Ini yang jarang disadari. Ketika Google Bot mengunjungi 1 halaman, dia gak hanya download HTML-nya saja loh.

Dia juga harus download CSS, JavaScript, gambar, dan file pendukung lainnya untuk bisa membaca halaman tersebut.

Di banyak website yang Saya audit, lebih dari 70% crawl requests ternyata digunakan untuk memuat resources (JS, CSS, JSON), bukan untuk mengunjungi halaman itu sendiri. Artinya dari setiap 10 request Google Bot, hanya 2–3 yang benar-benar mengunjungi halaman. Sisanya sibuk download file pendukung.

Nah, balik ke quality inspector tadi. Dari 2 jam jatah kunjungan, 1 jam 25 menit dia habiskan cuma untuk baca brosur dan katalog toko kamu. Cuma 35 menit yang benar-benar dipakai untuk cek produk di rak.

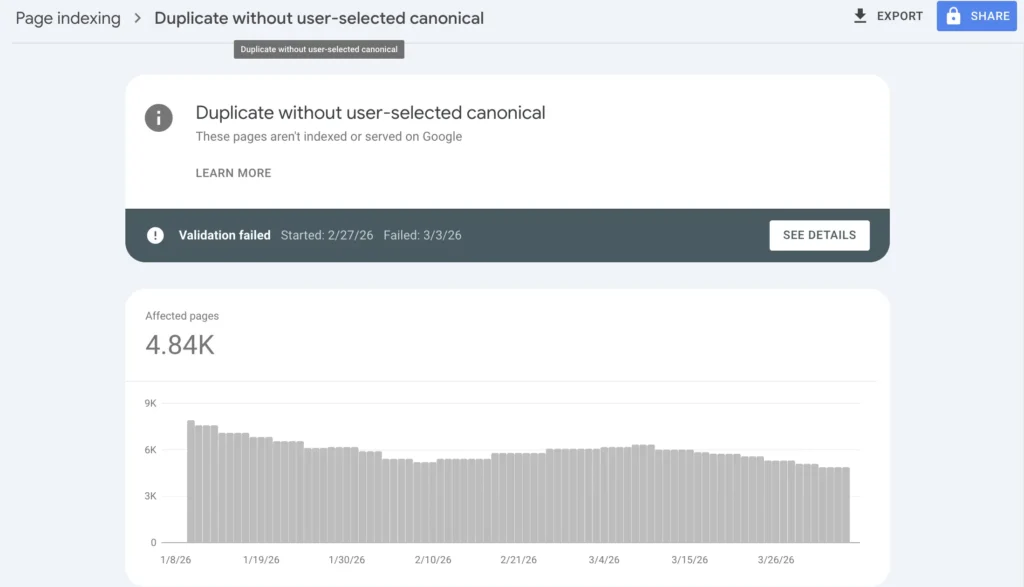

Ketiga, halaman expired yang masih “hidup”

Ini yang sering terjadi nih, website yang punya halaman dengan tanggal kedaluwarsa (seperti lowongan kerja, promo, event) sering lupa membersihkan halaman yang sudah expired. Halaman-halaman ini masih bisa diakses, masih ada di sitemap, dan Google Bot masih terus mengunjunginya.

Di beberapa kasus yang kami tangani, 5–10% dari total crawl requests terbuang untuk halaman-halaman yang sudah tidak relevan. Itu ratusan ribu request dalam hitungan bulan yang benar-benar zero value.

Keempat, sitemap yang tidak akurat

Sitemap seharusnya menjadi peta prioritas buat Google. “Ini halaman-halaman penting saya, tolong kunjungi.”

Tapi kalau sitemapnya berisi URL yang expired, lastmod-nya tidak akurat, atau coverage-nya terlalu rendah dari total halaman, Google akan mengabaikan sinyal dari sitemap dan crawl berdasarkan pola sendiri.

Hasilnya? Crawl jadi tidak terarah.

Apa Dampaknya ke Bisnis?

Kalau kamu business owners, maka crawl budget yang bocor itu ibaratkan kamu udah ngiklan jutuaan rupiah perbulaan, tapi gak ada hasilnya sama sekali.

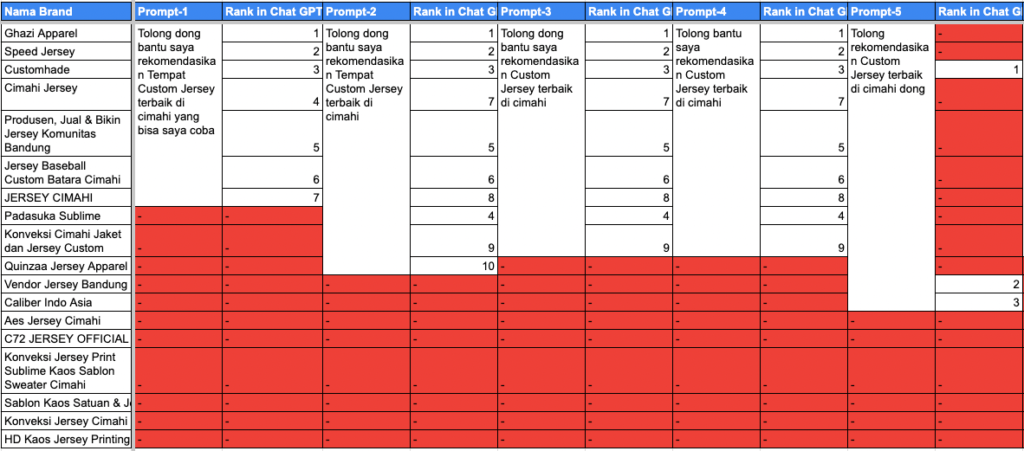

Halaman produk baru, artikel baru, atau landing page baru yang telah di-publish butuh waktu berminggu-minggu bahkan berbulan-bulan untuk muncul di Google. Sementara kompetitor yang punya crawl budget efisien, halaman baru mereka bisa muncul dalam hitungan hari bahkan ada juga yang hitungan jam.

Dalam industri yang bergerak cepat seperti e-commerce, job portal, atau media, kecepatan indexing itu sangat krusial loh. Kalau lowongan kerja baru butuh 3 minggu untuk muncul di Google, kemungkinan besar lowongan itu sudah expired sebelum sempat mendatangkan Leads.

Bagaimana Cara Memperbaikinya?

Mau banget nih bisa optimasi crawl budget, kalau gak mau skip saja, langsung close artikel ini :v, tapi kalau mau tahu cara optimasinya, ayo lanjut baca!

Berikut beberapa langkah yang saya rekomendasikan berdasarkan pengalaman menangani berbagai website:

1. Bersihkan halaman error

Identifikasi URL yang konsisten return 4xx atau 5xx. Kalau memang sudah tidak ada, return 410 (Gone) agar Google berhenti mengunjungi. Kalau seharusnya ada tapi error, perbaiki.

2. Kurangi beban resource

Audit berapa banyak file JS dan CSS yang harus di-download untuk merender satu halaman. Apakah semua script itu benar-benar dibutuhkan? Kami pernah menemukan website yang load 20+ third-party scripts di setiap halaman, termasuk beberapa yang sebenarnya tidak relevan untuk halaman tersebut.

3. Kelola konten expired

Buat sistem otomatis yang menghapus halaman expired dari sitemap dan memberikan sinyal yang tepat ke Google. Jangan biarkan Google Bot menghabiskan waktu mengunjungi halaman yang sudah tidak relevan.

4. Perbaiki sitemap

Pastikan sitemap mencakup semua halaman penting, lastmod akurat per halaman, dan di-update secara berkala.

5. Manfaatkan robots.txt

Blokir URL pattern yang tidak perlu di-crawl seperti halaman parameter, URL legacy, dan path yang tidak menghasilkan value untuk pencarian.

Ini Bukan Cuma Masalah Website Besar

Saya tebak, sebagian kamu pasti pernah atau akan ngomong gini iya gak? “Website saya cuma ratusan halaman, seharusnya gak masalah soal Crawl Budget.”

Eits, belum tentu. Website dengan 239 halaman milik client Apookat lainnya pun bisa punya masalah crawl budget kalau strukturnya berantakan.

Halaman duplikat, redirect chains, URL parameter yang tidak terkontrol, semua ini bisa menghabiskan crawl budget meskipun total halaman website kamu tidak banyak.

Prinsipnya tetap sama kok, pastikan Google Bot menghabiskan waktunya untuk halaman yang benar-benar penting, bukan halaman yang tidak memberikan value.

Kesimpulan

Ingat! Crawl budget itu bukan sesuatu yang bisa kamu beli atau tambah.

Tapi kamu bisa memastikan “waktu” yang ada sebisa mungkin digunakan seefisien mungkin. Ibarat quality inspector tadi, kamu nggak bisa minta dia datang lebih lama.

Tapi kamu bisa memastikan selama dia di toko Apookat Mart yang kamu miliki, dia langsung diarahkan ke produk-produk terbaik, bukan muter-muter di lorong yang kosong.

Kalau kamu merasa halaman-halaman baru di website kamu lama muncul di Google, atau organic traffic tidak bertumbuh meskipun konten terus ditambah, bisa jadi crawl budget kamu sedang bocor tanpa kamu sadari.

Butuh bantuan untuk audit crawl budget website kamu? Tim kami di Apookat siap bantu identifikasi di mana kebocorannya dan bagaimana cara memperbaikinya.

Apookat adalah creative agency yang berfokus pada growth business melalui SEO. Kami membantu bisnis menemukan dan memperbaiki hambatan teknis yang menghalangi pertumbuhan organic mereka.